Ce este deepfake audio. Noua metodă prin care mii de oameni sunt păcăliți și rămân fără bani în bancă

Reading Time: 11 minuteÎn luna februarie 2024 un contabil de la o multinațională din Hong Kong a fost păcălit într-un apel în videoconferință de hackeri care s-au dat drept superiorul său să plătească 25 de milioane de dolari. Deși victima a crezut că mesajul primit este unul de tip phishing, acesta a căzut în plasă și a făcut plata, atunci când în videoconferință a apărut o persoană care semăna a fi CFO-ul companiei și a vorbit întocmai ca acesta. Dar acesta nu este un caz izolat. Aceste tipuri de atacuri extrem de bine organizate și targetate sunt doar la început.

Bitdefender Labs a monitorizat îndeaproape cel mai recent mod de operare adoptat de infractori cibernetici, care au adaptat tehnologiile emergente pentru a fura bani de la consumatori.

Inteligența artificială este doar unul dintre numeroasele instrumente care contribuie la crearea și diseminarea cu succes a schemelor online menite să fure bani și informații sensibile.

Această lucrare analizează clonarea vocală (deepfake-ul audio) și modul în care fraudele bazate pe această tehnologie sunt răspândite prin rețelele de socializare pentru a înșela victime credule.

Înainte să abordăm în profunzime subiectul principal al cercetării noastre, îți oferim câteva informații despre cum se realizează clonarea vocală și care sunt cele mai periculoase utilizări.

Ce este clonarea vocală?

Clonarea vocală este procesul de utilizare a instrumentelor AI pentru a crea o copie sintetică a vocii unei persoane. Această tehnologie sofisticată utilizează tehnici de deep learning pentru a reproduce stilul de a vorbi al unei persoane cu scopul de a crea conținut audio extrem de realist și convingător, redat de o voce umană. Comparativ cu vocile sintetice generate în întregime de un computer utilizând sisteme învechite de tipul text-to-speech, clonarea vocală folosește efectiv vocea unei alte persoane pentru a produce o redare realistă a celei originale.

Clonarea vocală pe scurt:

- Obținerea mostrei – Primul pas în dezvoltarea unei voci sintetice este de a obține mostre de voce de la o persoană. Cu cât sunt obținute mai multe date vocale, cu atât vocea clonată va fi mai aproape de original. Este nevoie de doar câteva secunde de conținut audio preluat din orice videoclip de pe rețelele de socializare sau de o înregistrare fizică a persoanei în timp ce vorbește.

- Analiză – După ce sunt colectate datele vocale, software-ul de clonare vocală le analizează pentru a identifica trăsăturile vocii respective, precum timbru, ton, ritm, volum și alte trăsături.

- Instruirea modelului– Datele vocale sunt utilizate pentru a instrui un model de machine learning. Acest proces complex presupune introducerea datelor vocale într-un algoritm care învață să imite vocea originală.

- Sinteză – După ce este instruit, software-ul poate genera un discurs cu vocea clonată. Acest proces transformă informațiile text introduse într-un discurs care sună precum vocea originală.

- Rafinare – Autorii pot îmbunătăți constant nivelul calității vocii clonate sintetizate prin introducerea mai multor date în modelul de machine learning și reglarea parametrilor algoritmilor de clonare a vocii.

Clonarea vocii are nenumărate utilizări legitime în educație, sănătate și mediu, cum ar fi:

- Crearea de voice-over și asistenți vocali personalizați

- Dublarea vocilor actorilor în filme

- Asistență pentru persoanele cu defecte de vorbire

- Nararea cărților audio

- Crearea de postări pe mesajele de socializare

În pofida acestor numeroase utilizări legale, tehnologia de clonare vocală este adesea utilizată abuziv pentru desfășurarea de activități frauduloase. Fraudele care folosesc clonarea vocală utilizează inteligența artificială pentru a manipula, a înșela și a crea prejudicii financiare și fizice altor persoane. Aceste practici periculoase includ:

Atacatori care pretind a fi o rudă sau o persoană apropiată pentru a fura bani. Aceștia folosesc clonarea vocală pentru a crea mesaje audio sau înregistrări cu scopul de a păcăli victimele.

Schemele de răpire virtuală – infractorii cibernetici obțin bani de la familii pretinzând că le-au răpit persoane dragi.

Bullying-ul și șantajul cibernetic

Diferite scheme de inginerie socială care folosesc voci create cu ajutorul inteligenței artificiale (pentru a imita persoane faimoase) cu scopul de a manipula utilizatorii să acceseze linkuri periculoase sau să transfere bani.

Platformele de socializare – locul ideal pentru răspândirea fraudelor bazate pe clonarea vocală

În fiecare zi, platformele de socializare sunt utilizate de milioane de persoane, așa că nu e de mirare că acestea au devenit un teren propice pentru răspândirea unui număr mare de fraude emergente care utilizează AI și tehnologiile de clonare vocală. Cele două tehnologii au revoluționat industria, iar infractorii le-au exploatat cu promptitudine pentru a extinde sfera de acoperire a schemelor lor frauduloase.

În prezent, utilizarea rețelelor de socializare le oferă avantaje infractorilor nu numai din perspectiva numărului de victime potențiale, de conturi care pot fi compromise și de date personale care pot fi obținute ușor. Infractorii au învățat să-și adapteze abordarea utilizând instrumentele agențiilor de publicitate și reclamele pentru a putea ajunge la miliarde de utilizatori din întreaga lume.

În ultimul an, au existat îngrijorări semnificative în rândul consumatorilor din SUA în ceea ce privește expunerea la deepfake-uri și clonare vocală. Cu atât mai mult cu cât, în conformitate cu un sondaj recent efectuat de Voicebot și Pindrop, peste 57% dintre respondenți sunt îngrijorați de această problemă.

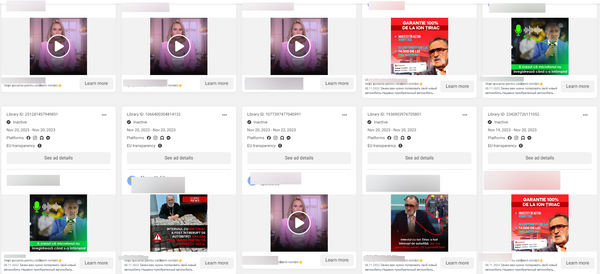

Bitdefender Labs a monitorizat îndeaproape fenomenul fraudelor bazate pe clonare vocală în ultimele săptămâni, în special pe platformele de socializare precum Facebook.

Cercetătorii noștri au descoperit rapid fraude care folosesc clonarea vocală distribuite pe bine-cunoscuta platformă de socializare a companiei Meta.

Iată câteva dintre constatările noastre principale:

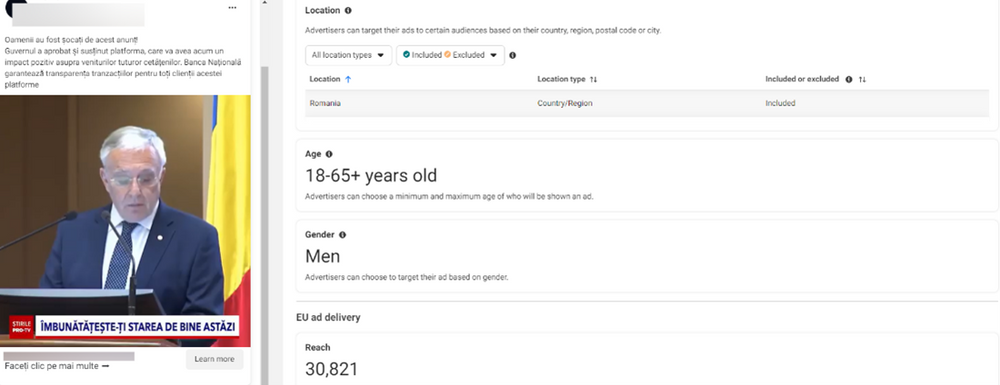

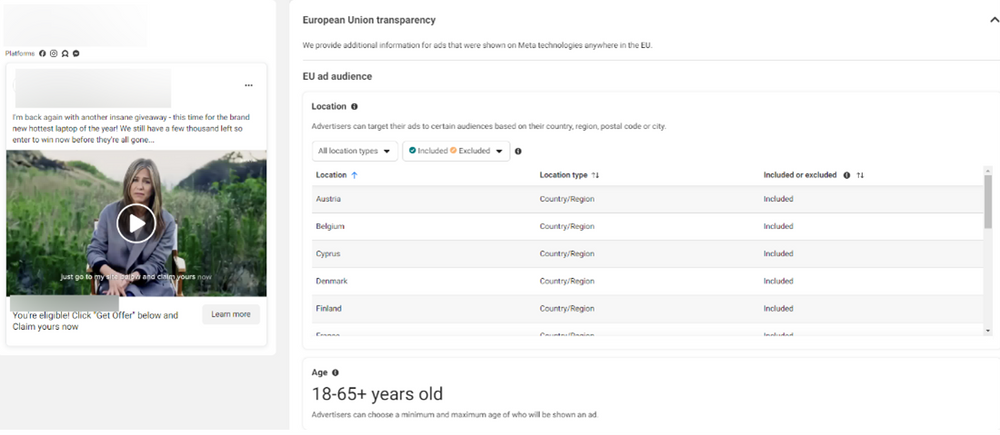

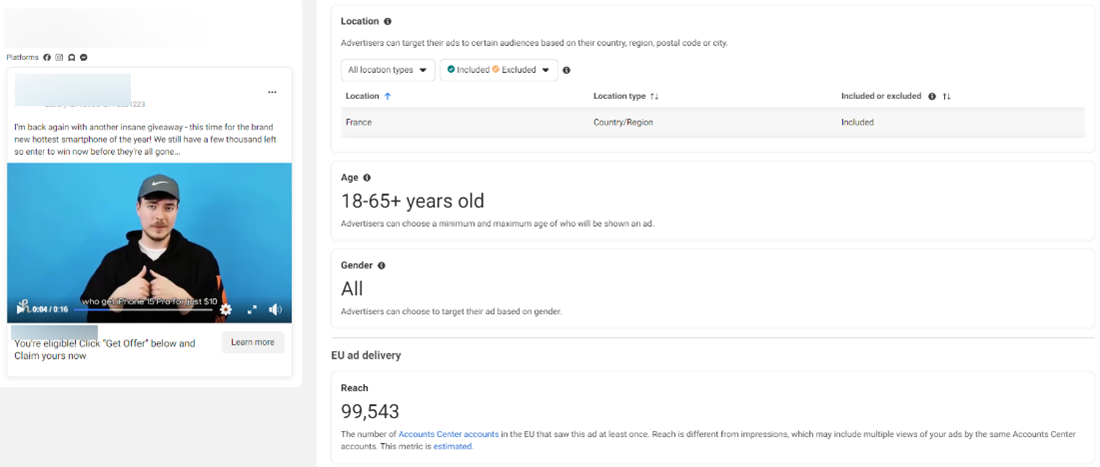

- Mare parte din conținutul fraudulos descoperit folosea instrumente bazate pe AI de generare vocală pentru a clona vocile unor celebrități cunoscute, cum ar fi Elon Musk, Jennifer Aniston, Oprah, Mr. Beast, Tiger Woods, Kylie Jenner, Hulk Hogan și Vin Diesel.

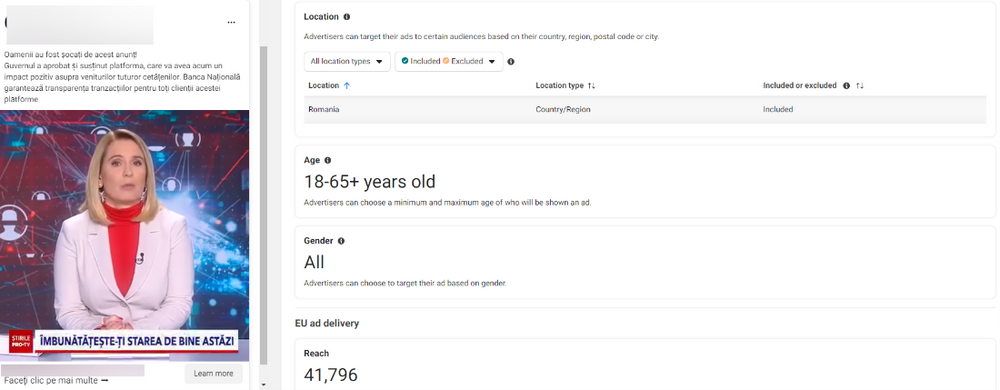

- Reclamele care conțin scam-uri create pentru a viza utilizatori din România foloseau videoclipuri furate cu voci generate sintetic ale moderatoarei de știri Andreea Esca, jucătoarei de tenis Simona Halep, Președintelui Klaus Iohannis, Prim Ministrului Marcel Ciolacu, Guvernatorului Băncii Naționale a României Mugur Isărescu și oamenilor de afaceri Gigi Becali și Ion Țiriac.

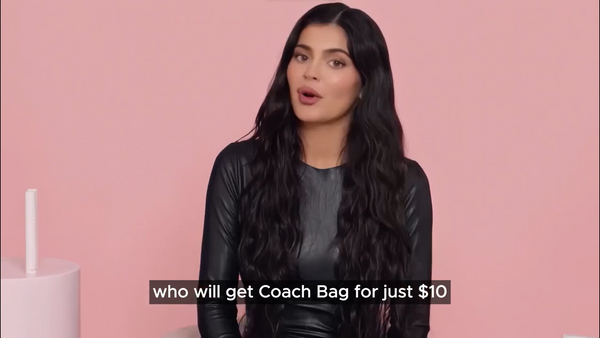

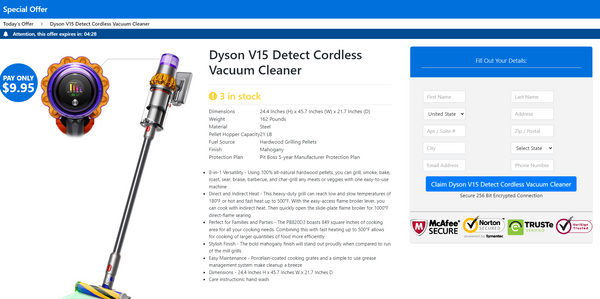

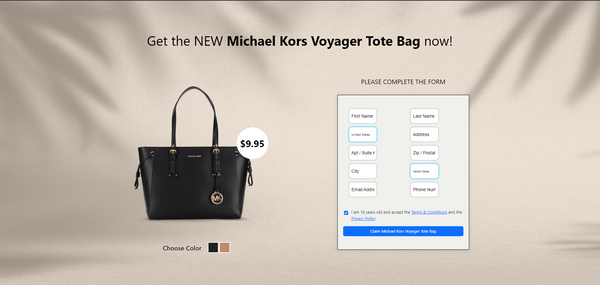

- Infractorii au folosit imagini ale acestor celebrități publice pentru a promova oferirea gratuită de bunuri scumpe, cum ar fi ultimul model de iPhone, MacBook-uri, scaune de mașină Chicco, seturi de scule DeWalt, aspiratoare Vacuum și genți Michael Kors sau Coach în schimbul sumei de doar 2 până la 15 dolari, pretinsă pentru transport.

- Alte subiecte des folosite în fraudele bazate pe clonarea vocală pe care le-am descoperit sunt investițiile și jocurile de noroc.

- Videoclipurile frauduloase folosesc același mod de operare care face referire la disponibilitatea limitată a produselor pentru primii 100/1000/10.000 de utilizatori norocoși care acționează rapid pentru a-și primi premiul sau pentru a se bucura de creșterea de cinci ori a sumelor investite.

- Aceste fraude care folosesc clonarea vocală ajung la consumatori prin reclame pe Facebook care îi redirecționează către site-uri web de tip scam, unde sunt promovate fie produse oferite gratuit, fie oportunități de investiții.

- În anumite cazuri, cei care fac clic pe reclame sunt redirecționați către un domeniu care afișează diferite pagini în funcție de parametrii de interogare utilizați. Dacă nu există parametri de interogare setați de Facebook în timpul redirecționării, utilizatorii sunt redirecționați către o pagină inofensivă. Acest comportament poate fi utilizat pentru a împiedica analiza în sandbox a domeniului. Însă, dacă au fost setați parametri de interogare, utilizatorilor li se afișează o pagină de scam.

- Majoritatea conținutului deepfake audio și videoclipurilor pe care l-am analizat este slab executat, conține artefacte și anomalii vizuale clare care nu există în videoclipurile reale, cum ar fi imagini distorsionate și neconcordanțe în mișcarea buzelor.

- Pentru a da credibilitate schemelor lor, infractorii au creat chiar și site-uri web false, care imită canale de știri populare. Mai exact, reclamele create pentru consumatorii din România erau asociate unei versiuni clonate a Digi24, Libertatea și Adevărul, în vreme ce alte reclame care vizau consumatori din alte țări utilizau o versiune falsă a site-ului web New York Times.

10. În urma analizării sferei de acoperire a reclamelor (pe baza numai a unui set mic de reclame frauduloase) estimăm că aceste fraude bazate pe clonare vocală au vizat cel puțin 1 milion de utilizatori din SUA și Europa, inclusiv din România, Franța, Austria, Belgia, Portugalia, Spania, Polonia, Suedia, Danemarca, Cipru și Olanda. Una dintre reclame a fost vizualizată de 100.000 de utilizatori și a fost activă timp de câteva zile. Însă fraudele bazate pe clonare vocală nu sunt limitate numai la zonele geografice menționate mai sus. Fenomenul este, cel mai probabil, global și adaptat tendințelor din rândul consumatorilor.

11. Reclamele frauduloase sunt răspândite pe următoarele platforme Meta: Facebook, Instagram, Audience Network și Messenger.

12. Segmentele de populație cele mai afectate sunt utilizatorii cu vârsta cuprinsă între 18 și 65 de ani.

Cum sunt puse în practică fraudele cu clonare vocală pe Facebook

În ultimele trei săptămâni, platformele de socializare ale companiei Meta au fost bombardate cu postări frauduloase care prezintă produse oferite gratuit de către celebrități, promițând acces la produse și servicii exclusive. Aceste scamuri, care sunt tot mai des întâlnite, exploatează încrederea firească și atracția utilizatorilor față de viața celor bogați și faimoși.

Este cunoscut faptul că celebritățile știu foarte bine cum să vândă lucruri publicului. Astfel, sunt șanse mari ca expunerea la reclame aparent promovate de celebrități pe rețelele de socializare să păcălească cu succes internauții creduli.

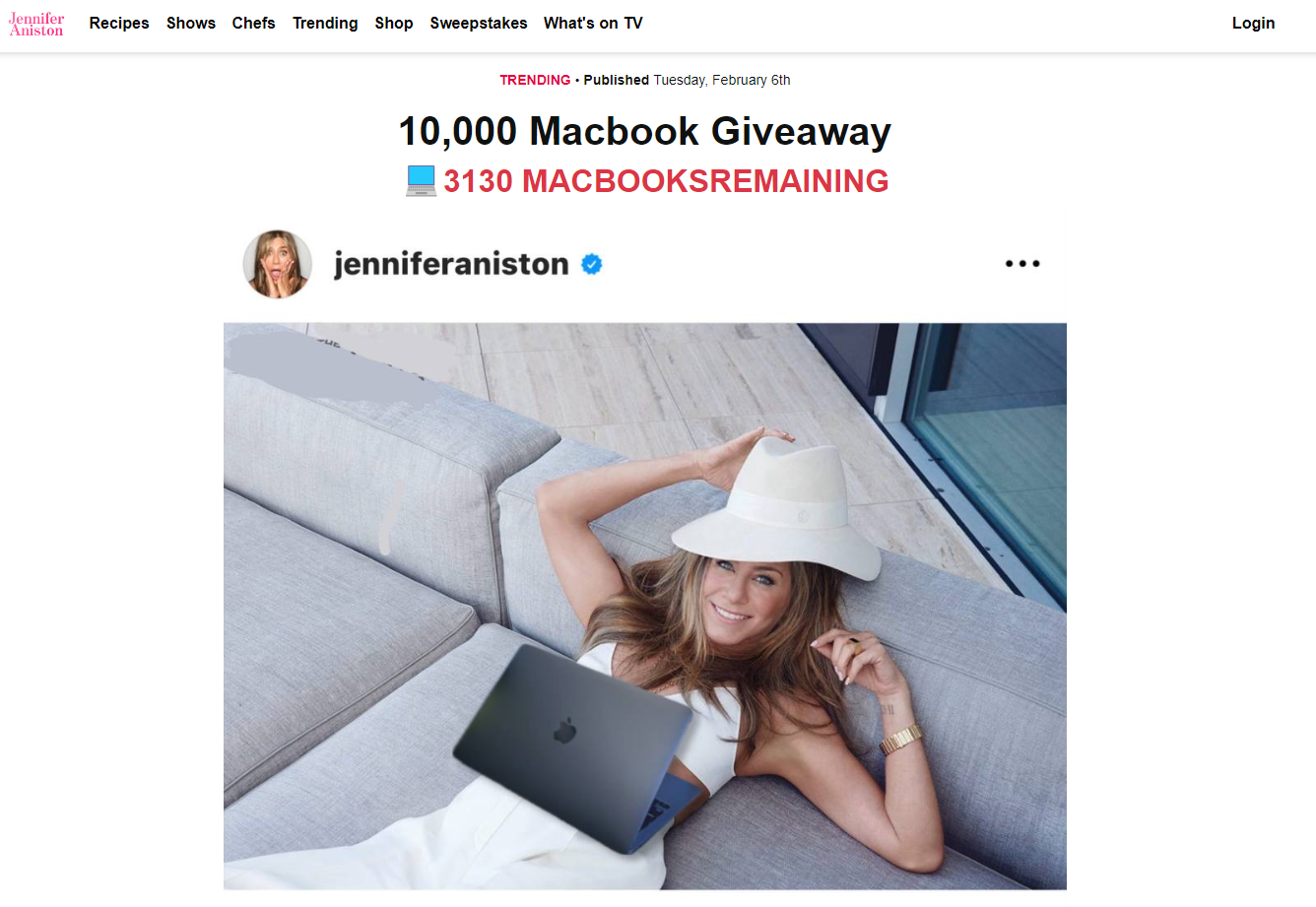

Consumatorii din SUA și Europa au fost expuși la diferite reclame cu conținut deepfake care prezintă celebrități cunoscute, precum Jennifer Aniston, Oprah și Mr. Beast care oferă produse gratuite unui număr de urmăritori norocoși.

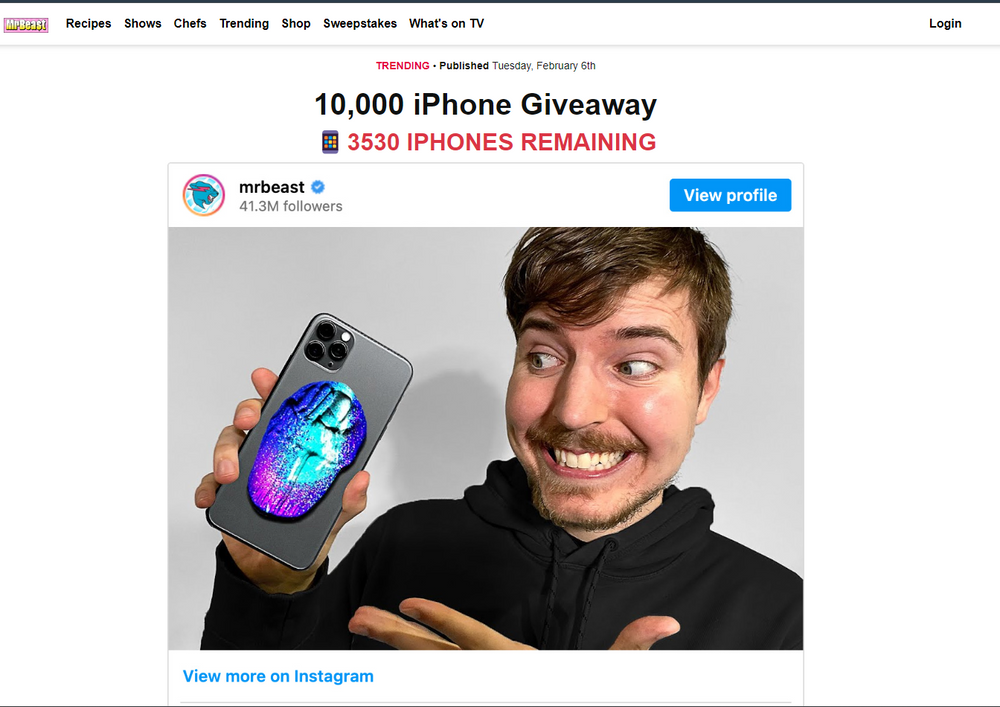

Toate videoclipurile deepfake pe care le-am analizat spun aceeași poveste inventată: cei care vizionează fac parte dintr-un „grup selectat de 10.000 de persoane” care au șansa să obțină produse exclusive în schimbul plății unei sume modice începând de la 2 dolari (în funcție de reclamă/produs). În captura de ecran de mai jos, infractorii au clonat vocea lui Mr. Beast, o personalitate pe YouTube, al cărui spirit caritabil i-a adus rapid faimă, devenind un star pe internet. De asemenea, când au modificat videoclipul, aceștia au realizat o sincronizare perfectă, videoclipul fiind unul dintre cele convingătoare și bine orchestrate deepfake-uri audio pe care le-am văzut în această campanie, până acum.

Videoclipurile promoționale durează maxim 30 de secunde și îi îndeamnă pe cei care o urmăresc să acționeze rapid și să facă clic pe un link pentru a beneficia de o „oportunitate incredibilă chiar acum”.

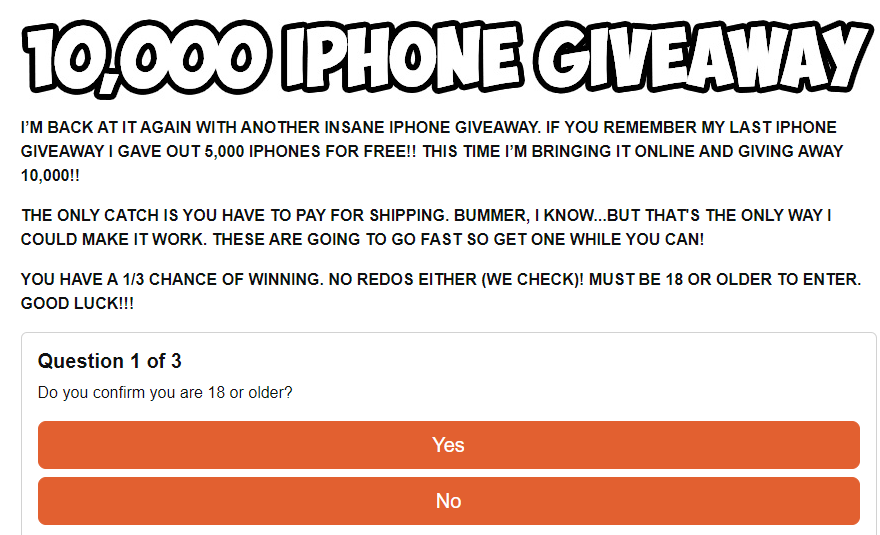

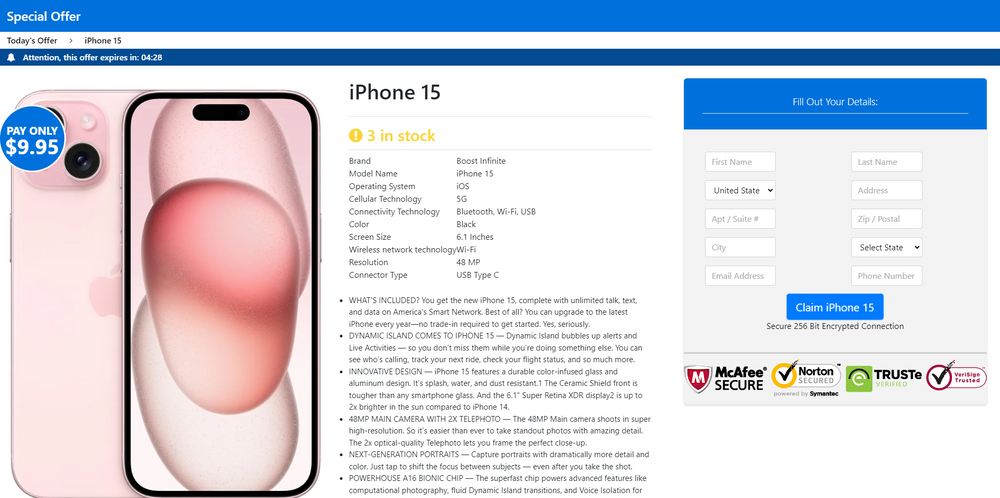

Care este trucul? În „cea mai mare campanie de promovare a iPhone 15”, cei norocoși trebuie să plătească numai costul transportului. Sună exagerat? Pentru că așa este.

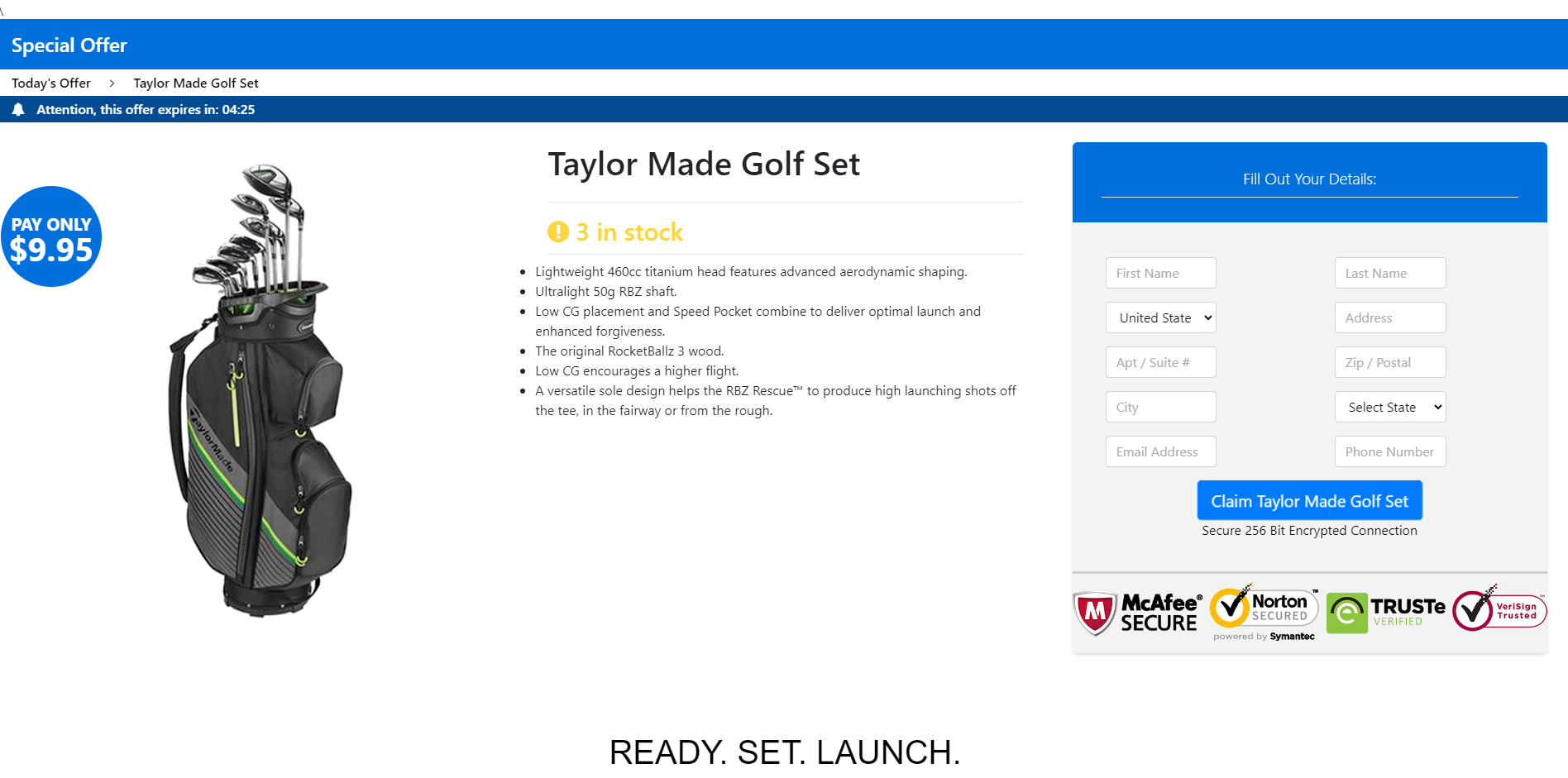

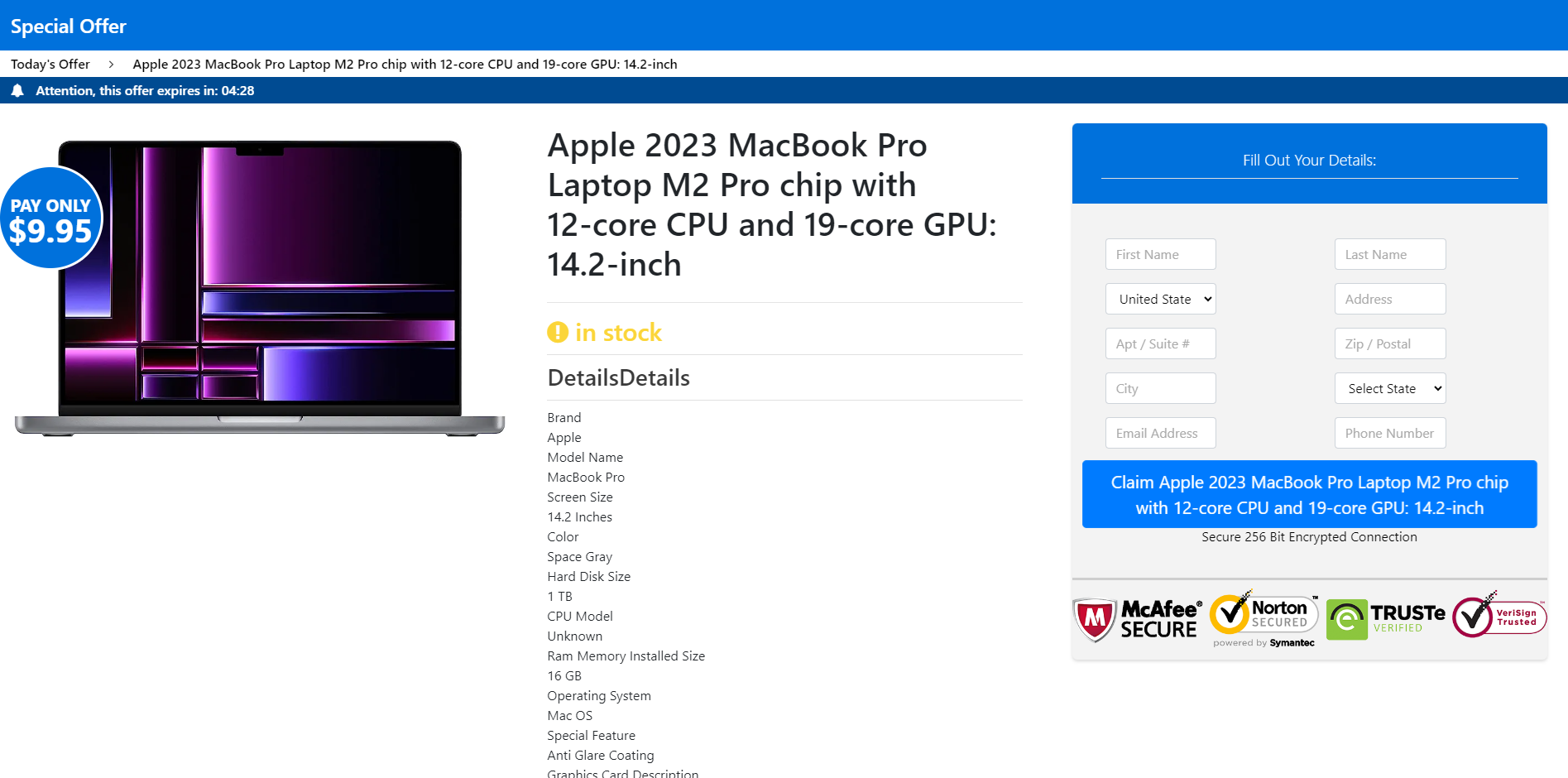

Când fac clic pe linkul fraudulos, utilizatorii sunt direcționați către un site fals care promovează oferta și care specifică un număr limitat de dispozitive/produse rămase.

Apoi ei trebuie să completeze un sondaj fals.

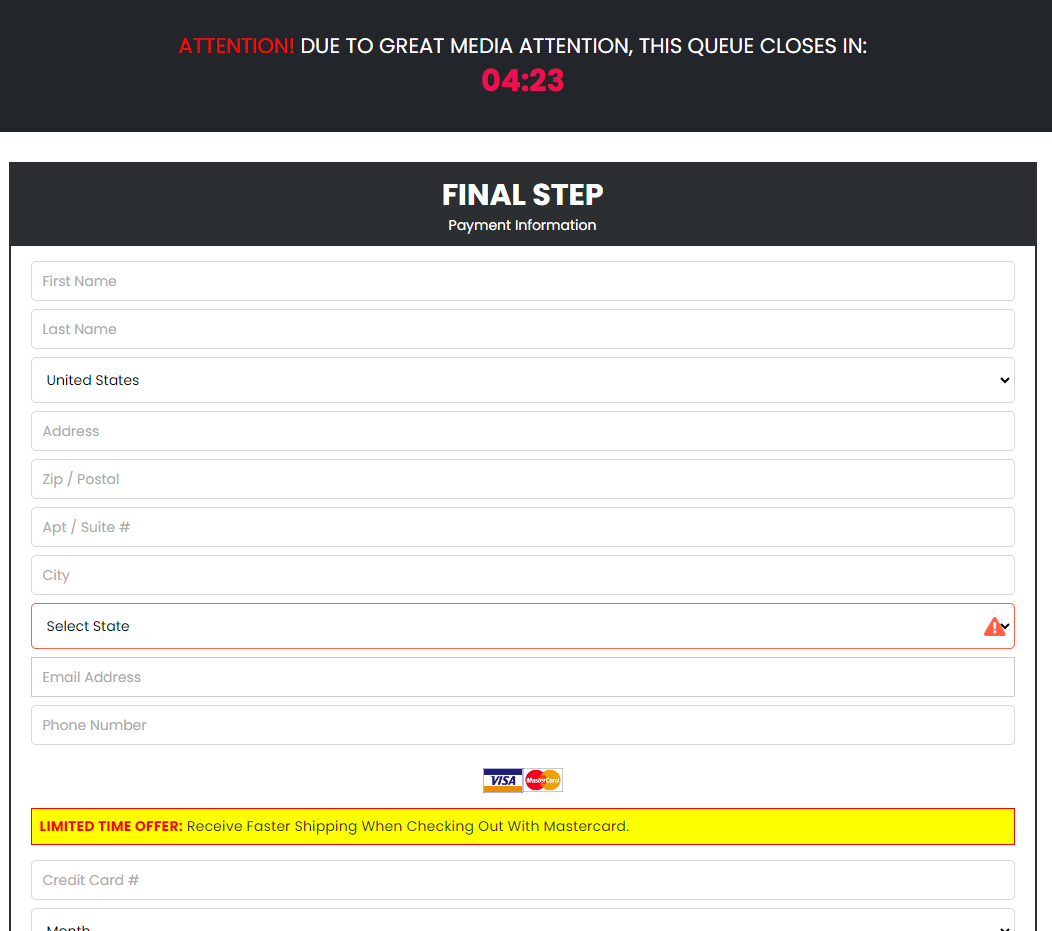

Pe ultima pagină, utilizatorul completează detalii despre livrare și efectuează plata. Suma este mai mare decât cea specificată în videoclip. Desigur, utilizatorul trebuie să furnizeze tot felul de detalii personale înainte să continue cu plata, cum ar fi nume, țara, adresa și date de contact (e-mail și număr de telefon).

La finalizare, utilizatorii trebuie să-și introducă numărul cardului bancar pentru a plăti pentru transport.

Mai jos am inclus și alte capturi de ecran cu reclame frauduloase bazate pe deepfake:

Fraude cu clonare vocală la noi acasă

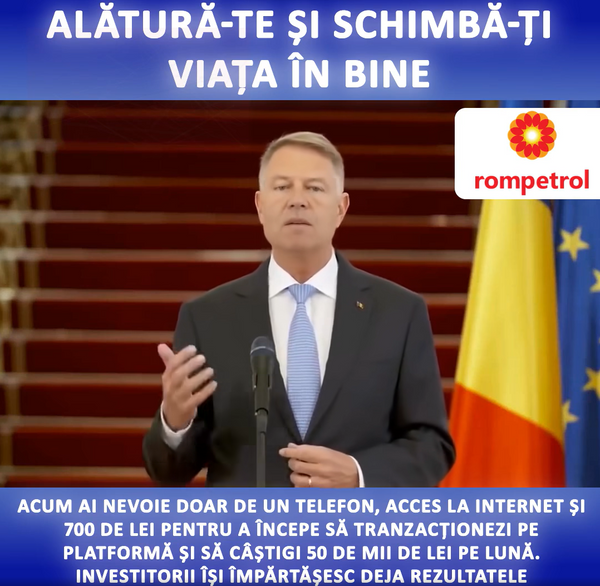

Și românii au fost vizați de hackeri prin răspândirea unor fraude dedicate privind oportunitățile de investiții, care utilizau clonarea vocală pentru a se da drept diferite personalități publice și politicieni.

De la jucătoarea de tenis Simona Halep la Președintele Klaus Iohannis, infractorii au inundat Facebook cu reclame false ce promovează o platformă de investiții susținută de guvern care le aduce utilizatorilor numeroase beneficii.

Videoclipurile pretind și că veniturile obținute pe platformă sunt considerate neimpozabile și garantate de Guvernul României și de Banca Națională a României. Unele oportunități de investiții false erau asociate unor nume mari de companii, precum Rompetrol și Hidroelectrica.

Investiția minimă pe platforma falsă pleca de la 700 de lei (aproape 150 de dolari), iar câștigurile potențiale promise erau de 2.750 de lei (540 de dolari) și urmau să fie obținute în doar două zile.

Pentru a se înregistra pe așa-zisele platforme de investiții susținute de guvern, utilizatorii români trebuiau să-și completeze numele și adresa de e-mail, dar și numărul de telefon.

Pe aceste site-uri frauduloase nu se solicitau numere de carduri sau alte metode de plată, însă, cel mai probabil, infractorii contactau victimele pe WhatsApp și e-mail pentru a face rost de mai multe informații personale și pentru a le lua banii.

Cum să te protejezi împotriva scamurilor audio deepfake?

Poate fi dificil să detectăm clonarea vocală, în special, având în vedere că evoluțiile în materie de inteligență artificială și tehnologia de deep learning au îmbunătățit semnificativ calitatea vocilor create sintetic.

Însă există câteva sfaturi pe care le poți aplica pentru a detecta și a te proteja împotriva clonării vocale:

1. Fii atent la calitatea și consecvența vocii: Analizează cu atenție calitatea vocii. Unele voci clonate pot avea un ton neobișnuit, pot fi statice sau un tipar de vorbire inconsecvent.

2. Zgomotul de fundal și artefactele: Deși clonarea vocală de înaltă calitate reduce zgomotul din fundal, într-un clip audio/video sintetic acesta încă poate fi perceput. Ascultă cu atenție pentru a identifica zgomot de fundal sau artefacte digitale.

3. Abordează cu atenție solicitările neobișnuite sau ofertele prea bune ca să fie adevărate. Fii precaut dacă cel care te apelează te presează să-i furnizezi informații cu caracter personal sau bani sau face solicitări neobișnuite. Scamurile cu clonare vocală sunt folosite pentru a-ți fura banii. Trebuie să analizezi întotdeauna cu atenție reclamele și videoclipurile care promit profituri mari din investiții, chiar dacă par a fi promovate de o celebritate, influencer pe rețelele de socializare sau politician.

4. Verifică: Dacă ai dubii, închide și contactează persoana sau organizația prin canalele oficiale. Nu folosi informațiile de contact oferite în timpul apelului.

5. Fii precaut când partajezi informații cu caracter personal: Ai grijă câte informații personale partajezi online și evită să-ți le oferi mostre vocale necunoscuților pe care îi întâlnești online. Infractorii pot utiliza orice detalii de pe rețelele de socializare pentru ca acel conținut în care își asumă identitatea să sune cât mai convingător.

6. Folosește programe de securitate pe dispozitivul tău: Utilizează soluții de securitate complete precum Bitdefender, care oferă mai multe caracteristici pentru a te proteja împotriva fraudelor și phishingului. Deși detecția clonării vocale nu este inclusă ca funcție, soluțiile noastre îți protejează banii și datele împotriva tentativelor de fraudă răspândite prin scamurile cu clonare vocală.

7. Folosește instrumente dedicate pentru a detecta fraudele: Fii cu un pas înaintea infractorilor utilizând Bitdefender Scamio, chatbotul nostru de ultimă generație și detector de scam bazat pe AI, pentru a afla dacă un anumit conținut online cu care interacționezi sau mesajele pe care le primești sunt tentative de fraudă.

8. Fii informat: Fii la curent cu cele mai noi informații despre amenințările la adresa securității și cum funcționează acestea. Citește articolele noastre de blog și newsletterele noastre pentru a afla despre scamurile online noi și existente și cum să te protejezi pe tine și pe familia ta.

9. Raportează: Raportează întotdeauna fraudele bazate pe clonare vocale pe care le întâlnești pe rețelele de socializare și informează poliția și alte organisme relevante cu privire la comportamente suspecte și tentative de fraudă.

Foto: DALL-E/OpenAI

Urmăriți Revista Biz și pe Google News. Abonamente Revista Biz